ABテストのサンプル数設計で成果が変わる理由

LPのABテストを3日で切り上げて「勝ちパターン」と判断したのに、本番反映したらCVR(コンバージョン率)が下がった——この失敗、心当たりはないでしょうか。

サンプル数を曖昧にしたままテストを回すと、結果の信頼性が足りずに判断を誤るか、逆に必要以上にテスト期間が伸びて施策のスピードが落ちます。「多ければ多いほど良い」という考え方も実は誤解で、本質は事業判断のスピードと統計的信頼性のバランスを設計することにあります。

結論からお伝えすると、ABテストのサンプル数設計とは「MDE(最小検出差)」「有意水準」「ベースラインCVR」の3つを決めることです。この記事では、その具体的な計算方法・早見表・失敗事例・実務フローを解説します。読み終える頃には、自社のトラフィック量と事業目標に合ったサンプル数設計ができるようになります。

ABテスト サンプル数の設計に必要な3つの変数

サンプル数を計算するには、以下の3つの変数を先に決める必要があります。計算ツールに数字を入れる前に、この3つを整理することがスタートラインです。

ベースラインCVR(現状の転換率)の把握

1. ベースラインCVR(現状の転換率)

すべての出発点は「今のCVRが何%か」です。ベースラインCVRが低いほど、改善を統計的に検出するために必要なサンプル数は増えます。例えばCVR 10%のページとCVR 1%のページでは、同じ改善幅を検出するのに必要なサンプル数が10倍以上変わります。

MDE(最小検出差)の定義

2. MDE(Minimum Detectable Effect:最小検出差)

「何%の改善を検出したいか」の設定です。MDEを10%に設定するなら、ベースラインCVR 3%のページで3.0%→3.3%の変化を検出したいという意味になります。MDEを小さくするほど精密に検出できますが、必要サンプル数は跳ね上がります。

有意水準(α)と検出力(1-β)の設定

3. 有意水準(α)と検出力(1-β)

- 有意水準(α):偽陽性を許容する確率。業界標準は5%(有意水準95%)

- 検出力(1-β):実際に差がある場合に検出できる確率。業界標準は80%

有意水準95%・検出力80%が標準とされていますが、事業判断のスピードを優先するケースでは有意水準90%(α=10%)で設計することも現実的な選択肢です。

ABテスト サンプル数の計算方法と具体的な数字

サンプル数の計算は、二項検定ベースの近似式で求めるのが一般的です。実務では計算ツールを使いますが、構造を理解しておくとMDE設定の判断がしやすくなります。

計算の基本構造は以下のとおりです。

1群あたりの必要サンプル数 ≈ (Zα/2 + Zβ)² × (p₁(1-p₁) + p₂(1-p₂)) / (p₁ - p₂)²

p₁:ベースラインCVR、p₂:期待CVR(p₁ × (1 + MDE))、Zα/2・Zβ:正規分布のZ値

この式から読み取れるポイントは3つあります。

- ベースラインCVRが低いほど:分子の分散が大きくなり、必要サンプル数が増える

- MDEが小さいほど:分母が小さくなり、必要サンプル数が急増する

- 有意水準・検出力を上げるほど:Z値が大きくなり、必要サンプル数が増える

具体例で見る必要サンプル数

ケース1:ベースラインCVR 3%、MDE 20%改善を検出したい場合

期待CVRは3.6%。有意水準95%・検出力80%の条件で計算すると、1群あたり約21,000サンプルが必要です。2群(AとB)で合計約42,000サンプルになります。

ケース2:ベースラインCVR 1%、MDE 10%改善を検出したい場合

期待CVRは1.1%。同じ条件で計算すると、1群あたり約15万サンプルが必要です。月間PVが10万のサイトでは、テスト完了までに約3か月かかる計算になり、現実的ではありません。

このように、ベースラインCVRが低いほど必要サンプル数は指数的に増加します。CVR 1%の環境でMDE 10%を求めるのは、ほとんどの事業で非現実的です。

CVR×MDE別の必要サンプル数早見表

以下は有意水準95%・検出力80%の条件で、ベースラインCVRとMDEの組み合わせごとに必要な1群あたりのサンプル数をまとめた早見表です。自社のCVRとMDEを当てはめて、必要サンプル数の目安を確認してください。

| ベースラインCVR | MDE 5% | MDE 10% | MDE 20% | MDE 30% |

|---|---|---|---|---|

| 1% | 約630,000 | 約157,000 | 約39,000 | 約17,500 |

| 2% | 約310,000 | 約78,000 | 約19,500 | 約8,700 |

| 3% | 約205,000 | 約51,000 | 約13,000 | 約5,700 |

| 5% | 約120,000 | 約30,000 | 約7,700 | 約3,400 |

| 10% | 約57,000 | 約14,500 | 約3,600 | 約1,600 |

この表の数値は近似値です。実際の計算ではツールによって多少のばらつきがあります。重要なのは「自社のCVRでMDE 5%を検出するのが現実的かどうか」をこの表で判断できることです。

例えば、月間PV 5万のBtoBサイトでCVR 2%・MDE 10%を検出したい場合、1群あたり約78,000サンプルが必要で、2群合計約156,000サンプル。テスト完了まで約3か月かかります。この場合、MDEを20%に上げれば約39,000サンプルで済み、約1か月で判断できる計算になります。

サンプル数計算に使えるツールとその選び方

サンプル数の計算は手計算でも可能ですが、実務ではツールを使うのが一般的です。ただし、ツールに数値を入力する前にMDE設定の判断が先にあることを忘れないでください。ツールは計算を代行するだけで、「何%の改善を検出したいか」は事業側が決めることです。

無料の計算ツール

無料の計算ツール

- Evan Miller Sample Size Calculator:シンプルで広く使われている計算機。ベースラインCVR・MDE・有意水準・検出力を入力するだけで必要サンプル数が算出されます

- Optimizely Sample Size Calculator:Optimizely公式が提供する無料ツール

ABテストツール内蔵の計算機能

ABテストツール内蔵の計算機能

- VWO:ABテストプラットフォームとして利用でき、サンプルサイズ計算機能も内蔵。テスト設計からレポートまで一貫して管理できます

- AB Tasty:フランス発のABテストツールで、サンプル設計機能を持ちます。日本語対応もあり

Googleオプティマイズは2026年9月に提供を終了しています。現在ABテストツールを選ぶ際は、VWO・AB Tasty・Optimizelyが主要な選択肢です。

ツール選びで重視すべきポイント

ツール選びのポイントは「計算機能があるか」よりも「テスト設計→実行→結果判定の運用フロー全体をどこまでカバーするか」です。サンプル数計算だけならEvan Millerの無料ツールで十分対応できます。

MDE(最小検出差)の設定がABテスト サンプル数設計の最重要判断

サンプル数設計で実務上もっとも判断が分かれるのがMDE(Minimum Detectable Effect:最小検出差)の設定です。MDEとは「事業としてインパクトがある改善幅」を数値で定義したものであり、統計の問題ではなく事業の問題です。

MDE設定で起こる2つの失敗パターン

MDE設定で起こる2つの失敗パターンを整理します。

- MDEを小さくしすぎた場合:CVR 2%でMDE 5%(つまり2.0%→2.1%の改善検出)を設定すると、1群あたり約31万サンプルが必要になります。月間PV 10万のサイトでは6か月以上かかり、テストが実質的に終わりません

- MDEを大きくしすぎた場合:MDE 50%に設定すると少ないサンプルで判断できますが、実際に起きている15%の改善を「差がない」と判定してしまうリスクが生じます。改善の見逃しです

MDEは事業側が決めるべき数値

MDEの設定は「この改善幅がないと事業にインパクトがない」というラインを、事業側が明確にする作業です。統計の教科書には答えが載っていません。

事業規模・月間トラフィック別のMDE設定基準

MDEの現実的な設定は、月間トラフィック量によって制約を受けます。以下は、テスト期間を2〜4週間に収めるための目安です。

月間10万PV以上のサイトの場合

月間10万PV以上のサイト

MDE 10〜15%で設計しても、2〜3週間でテスト完了できるケースが多いです。この規模であれば比較的精密なテスト設計が可能で、CVR 3%のページなら3.0%→3.3〜3.45%の改善を検出できます。

月間1〜3万PVのサイトの場合

月間1〜3万PVのサイト

MDE 20〜30%に設定しないと、テスト期間が1か月を超えます。「20%改善を検出する」とは、CVR 3%なら3.0%→3.6%の変化を見るということです。小さな改善は検出できませんが、事業にインパクトのある変化は捉えられます。

月間1万PV未満のサイトの場合

月間1万PV未満のサイト

ABテストで統計的に意味のある結果を出すのが難しい規模です。CVR 3%・MDE 20%でも1群あたり約13,000サンプルが必要で、2群合計26,000サンプル。月間1万PVなら最短でも2.6か月かかります。この環境ではABテストより先に以下の手法を検討するのが現実的です。

- ヒートマップ・セッション録画でユーザー行動を分析

- ユーザーインタビュー(5人でも主要な問題の80%が発見可能とされている)

- 定性データに基づく大胆な改善を先に実行し、効果検証はABテストではなくビフォー・アフターの比較で行う

トラフィック不足時の有意水準調整という選択肢

トラフィックが足りないときに有意水準を90%に下げてサンプル数を妥協する選択もあります。リスク(偽陽性の確率が5%→10%に上がる)を理解した上で、事業判断のスピードを優先する判断として合理的です。

ABテスト サンプル数が足りないまま判断した失敗事例

LP改善の現場で実際に起きた失敗を共有します。

サンプル不足のまま本番反映した事例

あるBtoCサービスのLPで、CTAボタンの色とコピーを変更するABテストを実施しました。テスト開始から3日間、サンプル数は各群500程度。この時点でバリエーションBのCVRが4.2%と、コントロール(3.1%)を大きく上回っていました。「明確な差が出た」と判断し、バリエーションBを本番に反映しました。

ところが、本番反映後2週間のCVRは3.0%。コントロールと変わらないどころか、むしろ微減という結果になりました。

失敗の原因:曜日バイアスと偽陽性

原因は2つでした。

- 曜日バイアス:テスト開始が木曜日で、金〜日のトラフィック特性が偏っていた。このサービスは平日と週末でユーザー層が異なり、週末のCVRが全体的に高い傾向がありました

- サンプル不足による偽陽性(false positive):500サンプルではCVR 3%前後のページでMDE 20%を検出する力がなく、単なるランダムな揺れを「差」と誤認していました

失敗から導入した3つの運用ルール

この失敗から変えた運用ルールは以下の3つです。

- テスト期間は最低1〜2週間の完全な曜日サイクル(月〜日)を含める

- テスト開始前にサンプル数と期間を設計し、設計値に達するまでは結果を判断しない

- 3日目で「大きな差が出ている」ように見えても、それは判断材料にしない

早期終了で判断を誤るパターンと回避策

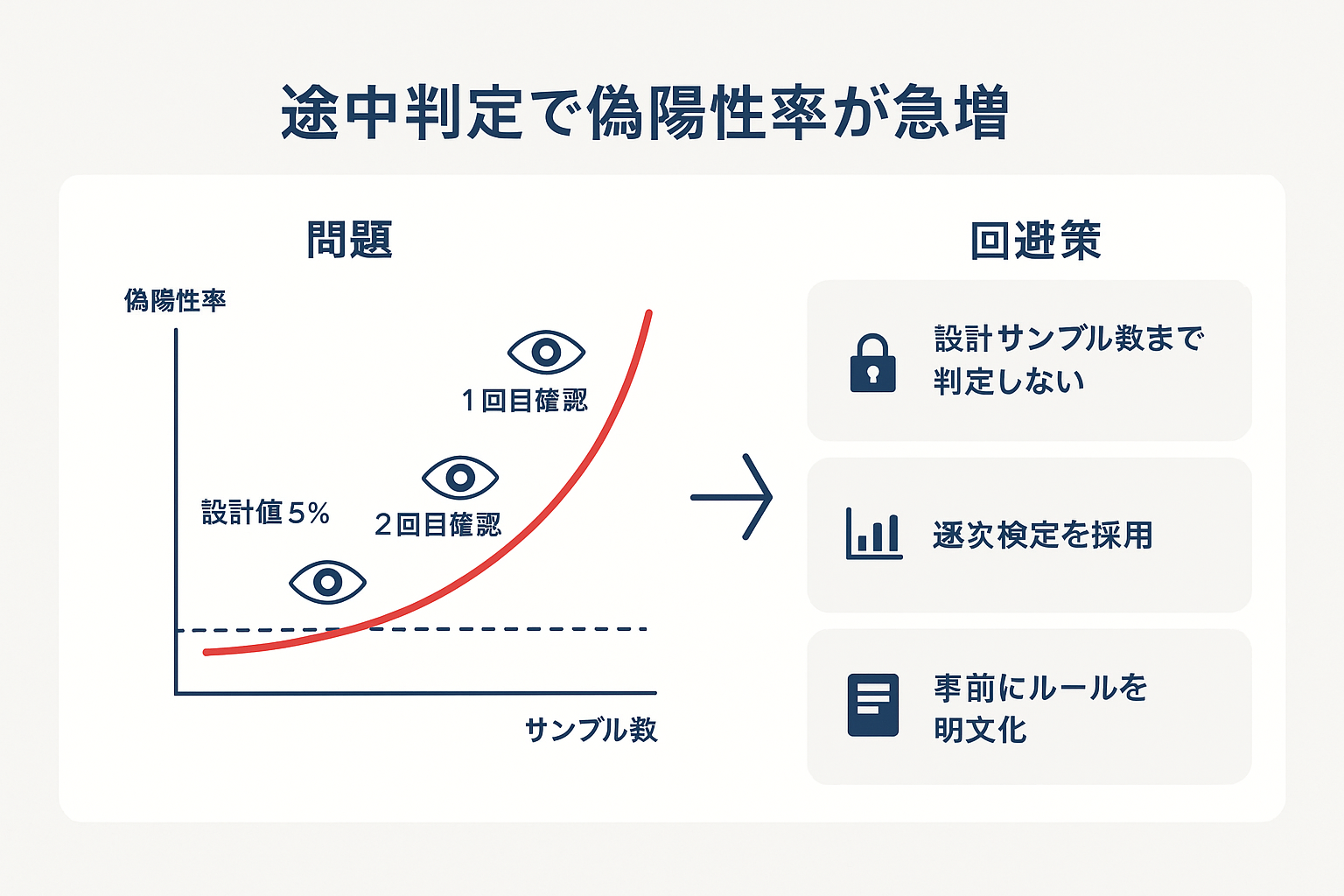

ABテストの途中経過を見て「もう有意差が出ているから止めよう」と判断したくなることがあります。これはpeeking problem(覗き見問題)と呼ばれ、ABテストの信頼性を損なう代表的な落とし穴です。

途中の有意差が信用できない理由

なぜ途中で有意差が出ても信用できないのか

統計的有意差の計算は「設計したサンプル数に達した時点で1回だけ判定する」前提で設計されています。途中で何度も検定を繰り返すと、偶然の揺れを「差がある」と判定する確率(偽陽性率)が5%から20〜30%以上に跳ね上がります。

早期終了を防ぐ3つの回避策

回避策は3つあります。

- 原則を守る:設計したサンプル数に達するまでは結果を判断しない。途中経過は「技術的なエラーがないか」の確認に留める

- 逐次検定(Sequential Testing)を採用する:Optimizelyなど一部ツールが採用している手法で、途中で有意差を判定しても偽陽性率をコントロールできる統計設計です。テスト期間を短縮できるメリットがあります

- チーム内で事前にルールを決める:「テスト結果の判定は○月○日以降に行う」と決めておき、途中で判断する誘惑を組織的に排除します

途中経過の確認と結果判定を分離する運用

私たちは「途中経過を見る担当」と「結果を判定する担当」を分けるルールを運用しています。途中経過の確認はテストの正常稼働チェックのみが目的で、有意差の判断は設計したサンプル数到達後に行います。

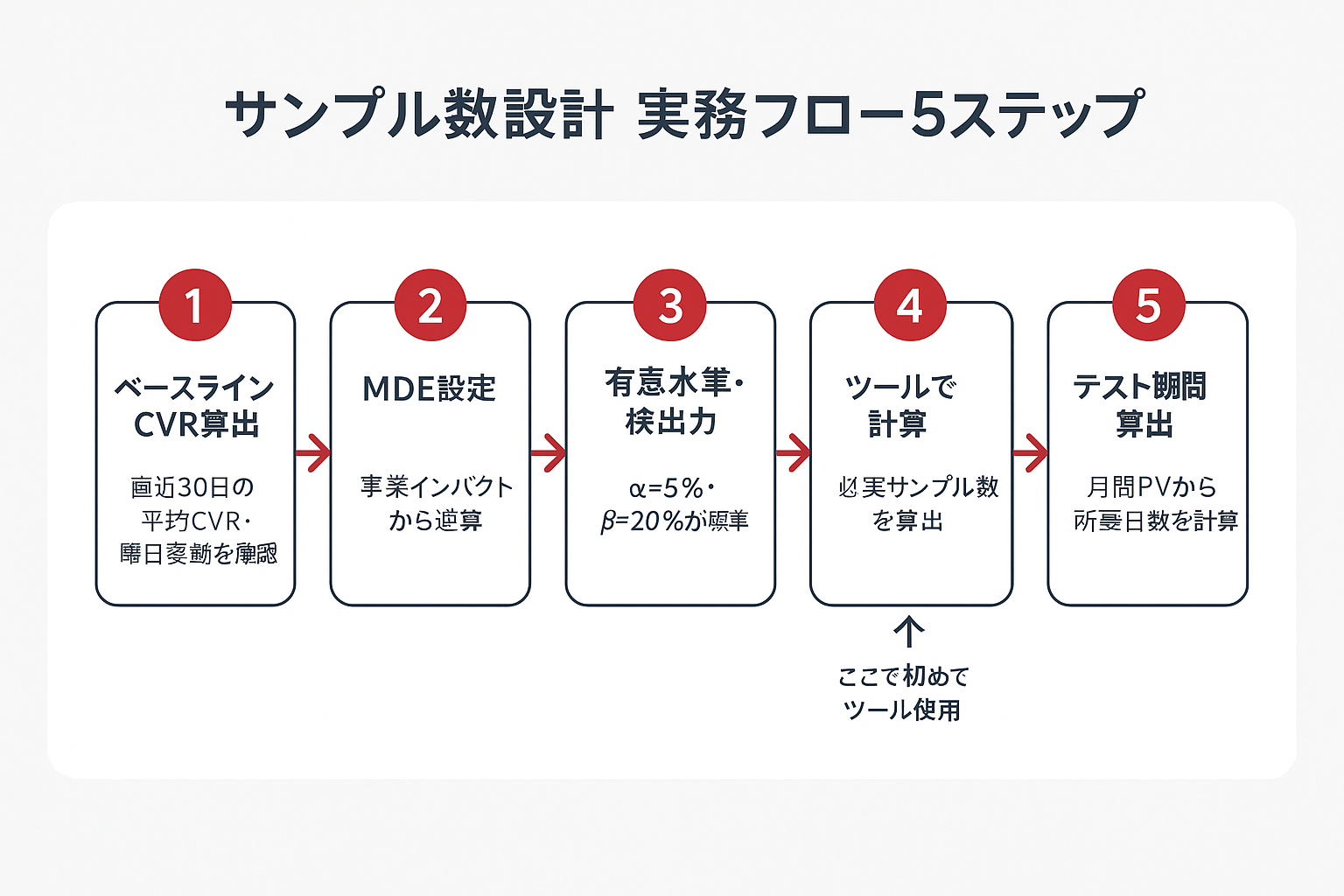

ABテスト サンプル数設計の実務フロー5ステップ

ここまでの内容を踏まえて、ABテストのサンプル数設計を5つのステップに整理します。計算ツールに数値を入れるのはStep4です。それまでの準備が設計の質を決めます。

Step1:ベースラインCVRを正確に算出する

- ベースラインCVRを正確に算出する

- 直近30日の平均CVRだけでなく、曜日別・週別の変動幅を確認します

- 季節要因やキャンペーンの影響がある期間は除外して算出します

- CVRの変動が大きいページは、そもそもABテストの精度が出にくい点に注意が必要です

Step2:事業インパクトからMDEを決める

- 事業インパクトから逆算してMDEを決める(次のH3で詳細を解説)

Step3:有意水準・検出力を設定する

- 有意水準・検出力を設定する

- 標準は有意水準95%(α=5%)・検出力80%(β=20%)

- スピード優先なら有意水準90%(α=10%)・検出力80%も選択肢

- 有意水準を下げるとサンプル数は約20%削減できますが、偽陽性リスクが倍になります

Step4:計算ツールで必要サンプル数を算出する

- サンプルサイズ計算ツールで必要数を算出する

- Evan Miller Sample Size CalculatorにStep1〜3の値を入力します

Step5:日次トラフィックから必要テスト期間を割り出す

- 日次トラフィックから必要テスト期間を割り出す

- 必要サンプル数 ÷ 日次トラフィック = 最低テスト日数

- この日数が14日未満の場合でも、1〜2週間の完全な曜日サイクルを確保します

- 日数が60日を超える場合は、MDEの見直しまたはテスト対象ページの変更を検討します

Step2 事業インパクトからMDEを逆算する方法

MDEの設定を「なんとなく10%」で済ませると、テスト設計が事業の実態と合わなくなります。以下の手順で、事業インパクトからMDEを逆算します。

MDE逆算の具体的な計算手順

計算手順

- 現在のベースラインCVRを確認する(例:CVR 2%)

- CVRが1ポイント改善した場合の月間リード増加数を計算する

- 月間PV 50,000 × CVR差分 0.1%(2.0%→2.1%)= 月間50件増

- リード1件あたりの価値を算出する

- リード→商談化率 30% × 商談→成約率 20% × 平均単価 50万円 = リード1件あたり3万円

- 月間リード増加 × リード価値 = 月間事業インパクト

- 50件 × 3万円 = 月間150万円

- このインパクトがテストにかけるコスト・期間に見合うかを判断する

理想のMDEと現実的なMDEのバランス

上記の例では、CVR 2.0%→2.1%(MDE 5%)の改善でも月間150万円のインパクトがあります。しかし、MDE 5%の検出には1群あたり約31万サンプルが必要で、月間PV 5万なら12か月以上かかります。

現実的には、MDE 20%(CVR 2.0%→2.4%)に設定し、月間600万円以上のインパクトがある改善だけを検出する設計にするのが合理的です。1群あたり約19,500サンプルで、2群合計39,000サンプル。月間PV 5万なら約25日でテスト完了できます。

「意味のある改善幅」は統計の問題ではなく事業側が決めることです。テストにかける期間と、その間の機会損失を天秤にかけて判断します。

ABテストのサンプル数に関するよくある質問

Q: ABテストでサンプル数が少ないときはどう対処しますか?

A: 3つの選択肢があります。第一に、MDEを大きくして必要サンプル数を減らす方法。MDE 10%→20%にするだけで必要サンプル数は約4分の1になります。第二に、テスト対象を全ページではなく特定の高トラフィックページに絞る方法。第三に、ABテスト自体を一旦やめて、ヒートマップやユーザーインタビューなどの定性調査に切り替える判断です。トラフィックが足りない環境で無理にABテストを回しても、信頼性の低い結果しか得られません。

Q: ABテストで有意差が出ないまま2週間経ったらどう判断しますか?

A: 「差がない」という結果も立派な結果です。設計したサンプル数に達しても有意差が出なかった場合、テストした変更はCVRに対して設定したMDE以上の影響を与えなかったと判断します。その仮説を捨てて次の仮説に移ることが、テストを事業成果につなげるうえで重要な判断です。ずるずるテスト期間を延ばしても、差がないものは差がありません。

Q: 複数バリエーションを同時にテストするとサンプル数はどうなりますか?

A: バリエーション数に比例して必要サンプル数が増えます。2バリエーション(A対B)なら合計2群ですが、3バリエーション(A対B対C)なら合計3群で、全体の必要サンプル数は1.5倍になります。また、多重比較補正(ボンフェローニ補正など)が必要になり、各比較の有意水準が厳しくなります。実務では同時テストは3パターンまでに抑えるのが現実的です。

Q: BtoBでコンバージョン数が少ない場合のABテストはどうしますか?

A: 最終コンバージョン(問い合わせ・資料請求)だけを計測指標にすると、必要サンプル数が膨大になりテストが成立しません。CTA到達率、フォーム入力開始率、スクロール深度など、最終CVの手前にある「マイクロコンバージョン」を計測指標として採用することで、必要サンプル数を大幅に減らせます。マイクロコンバージョンのCVRは最終CVRより高いため、現実的なサンプル数でテストが回ります。

Q: ABテストのサンプル数に「正解」の数はありますか?

A: 「何サンプル集めれば正解」という固定の数値はありません。正解はベースラインCVR・MDE・有意水準の3つの変数によって変わります。CVR 10%のECサイトとCVR 1%のBtoBサイトでは、同じ改善幅を検出するのに10倍以上の差があります。自社の状況に合わせて計算することが前提です。

BtoBでサンプル数が集まらないときの代替アプローチ

BtoBサイトではそもそも月間CVが数十件〜100件程度というケースが珍しくありません。この環境でCVRをABテストで検証するのは、統計的に成立しないことが多いです。その場合、以下のアプローチを検討します。

マイクロコンバージョンを計測指標にする

1. マイクロコンバージョンを計測指標にする

最終CV(問い合わせ完了)ではなく、CTAボタンのクリック率やフォーム到達率を指標にします。CVR 1%のページでもCTAクリック率は5〜10%あることが多く、必要サンプル数を5分の1〜10分の1に減らせます。

ヒートマップ・セッション録画で定性分析する

2. ヒートマップ・セッション録画で定性分析する

ABテストのように「AとBのどちらが良いか」を検証するのではなく、「ユーザーがどこで離脱しているか」「何に引っかかっているか」を可視化します。数百セッションの録画を分析するだけで、改善ポイントが見えることは多いです。

ユーザーテストを先行する

3. ユーザーテストを先行する

Nielsen Norman Groupの研究によると、5人のユーザーテストで主要なユーザビリティ問題の約85%が発見できるとされています。ABテストのように大量サンプルは不要で、数人のテストで大きな問題を洗い出し、改善した上でABテストに進む方が効率的です。

ABテストに固執しない判断が事業改善を加速させる

ABテストはあくまで仮説検証の手法の1つです。サンプルが集まらない環境で無理にABテストに固執するより、定性分析で仮説を磨いてから検証に進む方が、結果的に事業改善のスピードは上がります。

まとめ:ABテスト サンプル数設計は事業判断とセットで考える

サンプル数設計の本質は「どの程度の改善を、どの信頼度で、いつまでに検出するか」を事業判断として決めることです。計算ツールに数値を入力する作業は最後のステップであり、その前のMDE設計こそが実務上もっとも重要な判断ポイントです。

この記事のポイントを振り返ります。

- サンプル数は「ベースラインCVR」「MDE」「有意水準・検出力」の3変数で決まる

- ベースラインCVRが低いほど必要サンプル数は指数的に増える

- MDEは統計の問題ではなく、事業インパクトから逆算して決める

- テスト期間は最低1〜2週間の完全な曜日サイクルを含める

- 途中で有意差が出ても、設計したサンプル数に達するまで判断しない

- トラフィックが少ない環境では、ABテスト以外の手法を先に検討する

ABテストのやり方の全体像はこちらで解説しています。また、テスト設計を含めたLP改善の進め方も合わせて参考にしてください。

ABテスト サンプル数設計を事業成果につなげるために

サンプル数は手段であって目的ではありません。テストの先にある事業判断のスピードと精度を上げることがゴールです。

「CVRを改善したいけれど、テスト設計の判断に自信がない」「そもそもどこからABテストを始めるべきかわからない」——そうした課題があれば、一緒に考えましょう。私たちはLP改善のABテスト設計から実行・判定まで一貫して伴走しています。

参考文献

- Evan Miller「Sample Size Calculator」(https://www.evanmiller.org/ab-testing/sample-size.html)

- VWO「AB Test Sample Size Calculator」(https://vwo.com/tools/ab-test-sample-size-calculator/)

- Nielsen Norman Group「Why You Only Need to Test with 5 Users」(https://www.nngroup.com/articles/why-you-only-need-to-test-with-5-users/)